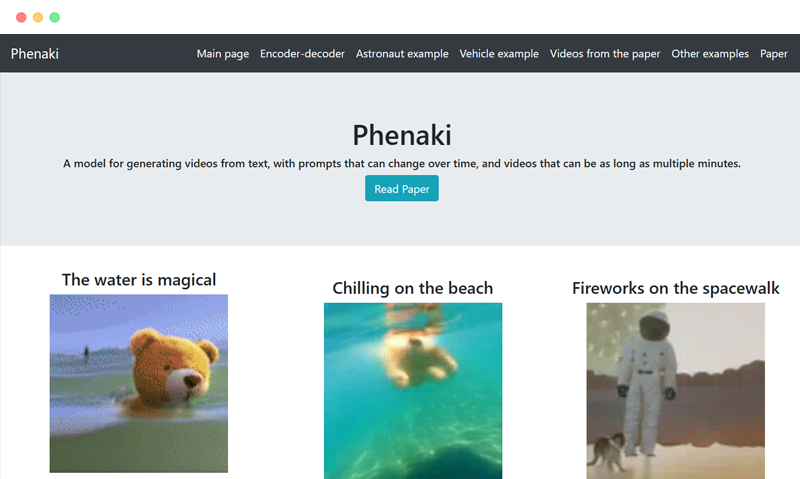

Phenaki是Google研究团队开发的一款能够从文本生成视频的AI模型,它可以根据用户输入的一系列文本提示,合成出逼真的视频画面。

这项技术在视频生成领域具有创新性和领先性,因为它能够应对多种挑战,例如高计算成本、可变视频长度、高质量文本视频数据的缺乏等。

Phenaki的主要组成部分有两个:一个是编码器-解码器模型,它可以将视频压缩为离散的嵌入或令牌,同时能够处理不同长度的视频;

另一个是变换器模型,它可以将文本嵌入转换为视频令牌,然后再解码为实际的视频。

Phenaki还利用了大量的图像-文本对数据和少量的视频-文本对数据进行联合训练,从而实现了对视频数据集之外的内容的泛化。

Phenaki目前已经能够根据开放域的时间可变文本或故事生成任意长度的视频,并且在空间-时间质量和每个视频的令牌数量上都优于目前文献中使用的逐帧基线。

特色功能

- 从时间可变文本生成视频:Phenaki可以根据用户输入的一系列文本提示,按照时间顺序生成对应的视频画面。这些文本提示可以是任意主题、风格和情节的,只要它们能够描述出清晰和连贯的场景。

- 生成逼真和多样化的视频:Phenaki可以生成高分辨率、高帧率、高动态范围和高色彩准确度的视频,同时保持画面的清晰度、稳定性和连续性。Phenaki还可以生成多样化和富有创意的视频,例如将现实中不存在或难以实现的场景呈现出来,或者将不同风格和元素进行混合和变换。

- 支持交互式和迭代式生成:Phenaki支持用户与模型进行交互式和迭代式生成,即用户可以在任何时候修改、添加或删除文本提示,然后观察模型如何调整视频输出。这样用户就可以根据自己的喜好和需求进行创作和编辑,实现更高程度的个性化和定制化。

收费价格

目前,Phenaki还没有正式发布为商业产品,因此还没有公布具体的价格信息。不过,根据Google研究团队在其网站上发布的信息,Phenaki目前已经开放了部分示例视频供用户在线观看,并且计划在未来提供更多的视频样本和交互式演示。

此外,Google研究团队还表示,他们正在探索将Phenaki应用于不同的领域和场景,例如教育、娱乐、广告、游戏等,以及与其他的视频处理技术进行结合,例如超分辨率、风格迁移、视频编辑等。

常见问题

Phenaki是如何工作的?

Phenaki的工作流程可以分为三个步骤:

- 第一步是将文本提示转换为文本嵌入,即用数值向量表示文本的语义信息;

- 第二步是将文本嵌入转换为视频令牌,即用离散的符号表示视频的视觉信息;

- 第三步是将视频令牌解码为视频画面,即用像素矩阵表示视频的图像信息。

这三个步骤分别由Phenaki的两个主要组件完成:一个是编码器-解码器模型,它负责视频的压缩和解压;另一个是变换器模型,它负责文本和视频之间的转换。

Phenaki是如何训练的?

Phenaki是在两种类型的数据集上进行联合训练的:

- 一种是图像-文本对数据集,它包含了大量的图像和与之相关的文本描述;

- 另一种是视频-文本对数据集,它包含了少量的视频和与之相关的文本描述。

通过在这两种数据集上进行联合训练,Phenaki可以学习到图像和文本之间的对应关系,以及视频和文本之间的对应关系。同时,Phenaki还可以利用图像-文本对数据集中的丰富信息来弥补视频-文本对数据集中的稀缺信息,从而实现对视频数据集之外的内容的泛化。

Phenaki有什么优势和局限性?

Phenaki相比于其他的视频生成方法有以下几个优势:

- 一是能够从时间可变文本生成视频,而不是仅仅从静态文本生成视频;

- 二是能够生成任意长度的视频,而不是仅仅生成固定长度或短时长的视频;

- 三是能够生成逼真和多样化的视频,而不是仅仅生成模糊和单调的视频。

然而,Phenaki也有一些局限性:一是需要大量的计算资源和时间来生成高质量的视频;二是可能会出现一些生成错误或不符合逻辑或物理规律的画面;三是可能会受到版权或道德等方面的限制或质疑。